Daniel Pilch

W codziennym życiu wiele prostych, powtarzalnych zadań nadal wymaga ludzkiej uwagi, od podniesienia przedmiotu po interakcję z otoczeniem. Stworzyłem robota, który potrafi samodzielnie zrozumieć przestrzeń, reagować na polecenia użytkownika i wykonywać proste czynności w sposób bezpieczny i elastyczny.

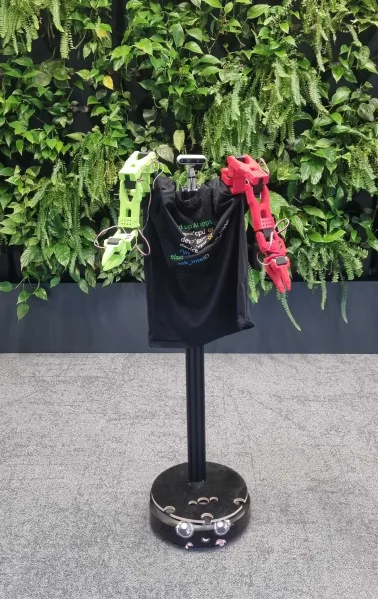

Zbudowany robot wyposażony jest w dwa ramiona robotyczne oraz system percepcji przestrzennej 3D. Oprogramowanie oparte na ROS 2 integruje moduły odpowiedzialne za nawigację, sterowanie manipulatorami i analizę otoczenia.

System przetwarza dane z kamer i czujników głębi, tworząc trójwymiarową mapę otoczenia. Dzięki algorytmom SLAM i metodom uczenia maszynowego robot potrafi lokalizować się w przestrzeni, rozpoznawać obiekty i planować trajektorie ruchu w czasie rzeczywistym.

Robot potrafi wykonywać praktyczne czynności, które można przekazać za pomacą języka naturalnego, np. „Przejedź do stołu i podnieś kubek”lub „Przesuń przedmiot z kanapy na biurko”. Zastosowanie modelu językowego umożliwia mu naturalną komunikację i interpretację poleceń kontekstowych.

Całość powstała przy koszcie poniżej 4000 zł, co czyni projekt wielokrotnie tańszym od systemu Mobile Aloha ze Stanford University (ok. 30 000 USD), a dodatkow zawiera pzaawansowane algorytmy percepcji, planowania i sterowania. Robot stanowi w pełni funkcjonalnego asystenta zdolnego do inteligentnego działania w środowisku człowieka.